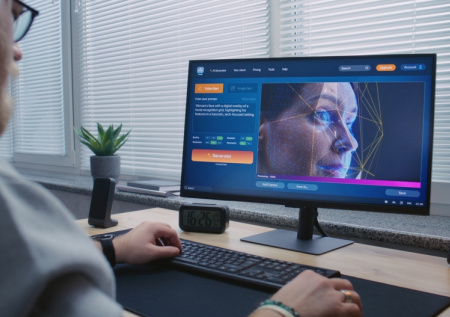

Компания OpenAI, известная разработкой нейросетей ChatGPT и DALL-E, делает ставку на «блестящие продукты», жертвуя при этом безопасностью, рассказал экс-сотрудник организации Ян Лейке в Twitter (X). По его словам, разработчикам искусственного интеллекта следовало бы уделять больше внимания вопросам конфиденциальности пользователей и проблеме социального воздействия.

«За последние годы культура и процессы безопасности отошли на второй план по сравнению с блестящими продуктами. Создание машин, которые были бы умнее человека, по своей сути является опасным занятием. OpenAI берет на себя огромную ответственность от имени всего человечества», — рассказал Лейке.

На публикацию вскоре отреагировал основатель OpenAI Сэм Альтман. Он признал наличие проблем с безопасностью в их разработках, а также заверил, что компания полна решимости решить задачу.

Ранее сообщалось, что компания Google была вынуждена отключить функцию генератора изображений в своей нейросети Gemini. Причиной тому стали многочисленные жалобы пользователей на некорректные изображения: в погоне за расовым разнообразием ИИ начал выдавать рисунки с темнокожими и азиатами в образе гитлеровских нацистов и викингов.