На днях канадский ютубер опубликовал ролик, который на первый взгляд выглядит как современный ремейк фильма «Назад в будущее» с актёрами из «Мстителей». Но на самом деле это будущее смотрит на нас с экрана, объявляя наступление эпохи, в которой уже нет никаких правил и нет границ между правдой и ложью. И от этого становится жутко.

Влогер с непроизносимым ником EZRyderX47 пытался добиться популярности в течение восьми лет и всё это время безуспешно публиковал видео с котиками, но стал мировой знаменитостью и привлёк внимание СМИ, только когда сменил подход к контенту. Он взял бесплатную и общедоступную программу Deepfacelab и с её помощью заставил звёзд Marvel Тома Холланда (Человека-паука) и Роберта Дауни-младшего (Железного человека) занять в фильме места Марти Макфлая и Дока.

Для полутораминутной демонстрации была выбрана сцена, в которой с попавшим в прошлое Марти флиртует его собственная мама. И, надо признать, выглядит подмена очень убедительно. Некоторый диссонанс вызывает только отсутствие у Дауни-младшего бороды и очков, а мимика, артикуляция, прорисовка в движении выполнены безукоризненно.

Конечно, технология подмены лиц родилась не сегодня. Ролик с цифровым Бараком Обамой ходил по Сети ещё пару лет назад. Но только сейчас стало понятно, насколько развился искусственный интеллект. У того же EZRyderX47 ещё пару месяцев назад выходил ролик, в котором Росомаху из «Людей Икс» «сыграл» Киану Ривз вместо Хью Джекмана. Лицо актёра сползало и подёргивалось, так что сразу было понятно — это монтаж. А вот с Марти и Доком таких проблем уже нет. Нейросеть стала умнее человеческого глаза.

Подобные технологии уже прямо сейчас используются для различных злоупотреблений. Так, совсем недавно отгремел скандал по поводу поддельного видео с Марком Цукербергом, а возмущение актрис и моделей, которых нейросеть без их ведома помещает в порнофильмы, уже никого не удивляет.

Тем временем мошенники научились похищать не только внешность людей, но и их голоса. Аналитики из Symantec утверждают, что с помощью программ — имитаторов человеческой речи уже были похищены миллионы долларов, когда финансистам крупных компаний давались указания о выводе средств голосами гендиректоров.

Но и это ещё не всё. ИИ научился не только имитировать людей, но и создавать поддельные личности. Так, например, стремительно набирают популярность алгоритмы, генерирующие лица несуществующих людей. Их используют, например, для придания достоверности фальшивым интернет-отзывам на товары и услуги.

Когда Западу потребовалось дискредитировать Башара Асада и разбомбить Сирию, в ход пошли видео, свидетельствующие о якобы имевших место химических атаках. Но для съёмок задействовали реальных людей, которых российские военные потом смогли отыскать и доставить в ООН для разоблачительных выступлений. А если бы такое видео было создано нейросетью, если бы на якобы документальных кадрах бомбы с белым фосфором калечили никогда не существовавших людей — как можно было бы вскрыть такой обман?

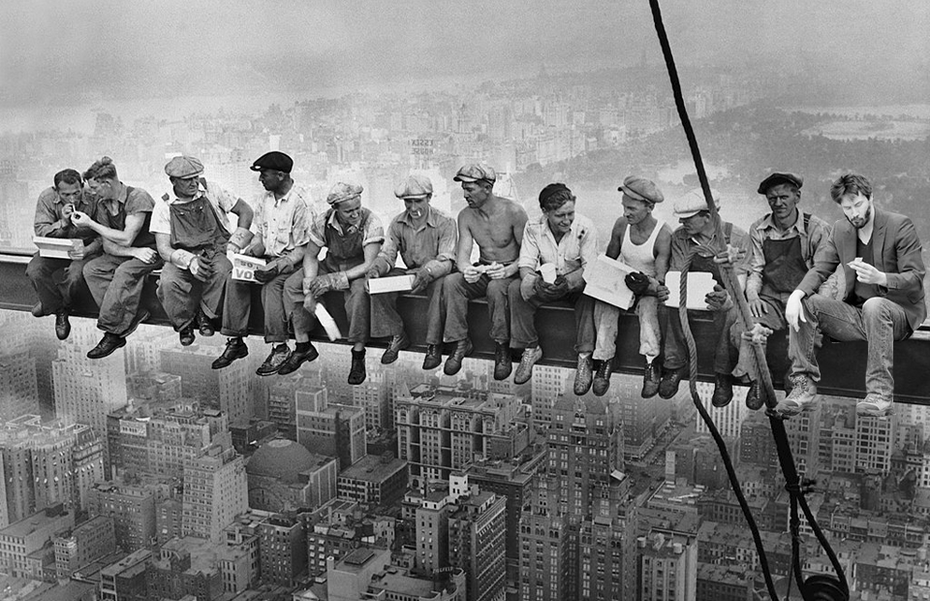

Недавно в украинском учебнике истории обнаружили фотожабу, на которой грустный Киану Ривз сидит рядом с рабочими, строившими в 1932 году Рокфеллер-центр в Нью-Йорке. Подделку, как вы понимаете, опознали только потому, что лицо актёра узнаваемо.

В учебнике истории 10-го класса использовалась обработанная в Photoshop версия знаменитой фотографии 1932 года «Обед на небоскребе». Киану Ривз справа.

В учебнике истории 10-го класса использовалась обработанная в Photoshop версия знаменитой фотографии 1932 года «Обед на небоскребе». Киану Ривз справа.

Этот случай не единственный в своём роде — пару лет назад в Саудовской Аравии изымали из оборота тираж учебников, в которых на фото рядом с королём Фейсалом во время его выступления в ООН оказался мастер Йода из «Звёздных войн». Но что если бы фото появилось не в учебнике, а, допустим, в Telegram-каналах? И вместо мастера-джедая рядом с монархом стоял бы известный террорист.

А скоро ли в телевизионный эфир просочатся поддельные видео? Сколько месяцев (или дней) осталось до того момента, когда мы уже не сможем верить свидетельствам «очевидцев» и снятым ими кадрам?

Я ни в коем случае не хочу сказать, что прогресс — это плохо или что нейросети — это потенциальный Скайнет, который однажды обретёт сознание и пойдёт войной на человечество. Но с тем, что технологии развиваются пугающими темпами, не поспоришь. Потому что мы не успеваем оценить их возможности и потенциальные опасности.

Искусственный интеллект при его сегодняшнем уровне развития (ну, по крайней мере, на тот момент, когда я это пишу) сам по себе не представляет опасности. Но мы можем оказаться беззащитными перед другими людьми, которые захотят использовать нейросеть в качестве оружия. Мы можем оказаться в мире, где правда и ложь неотличимы друг от друга.

Кто вытащит нас из Матрицы, которую мы создаём собственными руками? Кто станет нашим Нео?